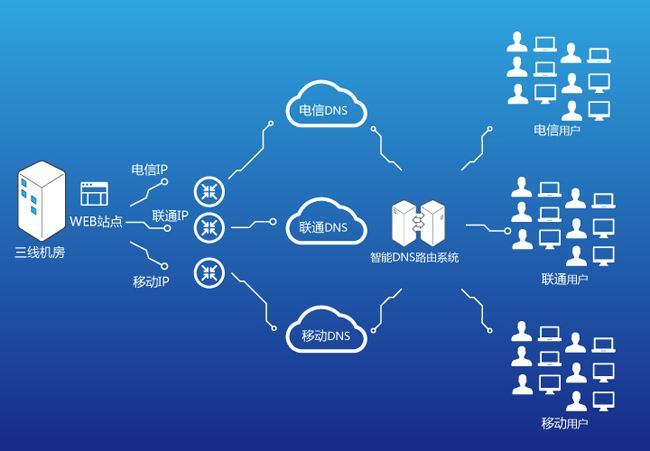

搜索引擎蜘蛛不断爬行互联网,如果我们网站没有做出禁止搜索引擎收录的操作,很容易就会被搜索引擎收录。那么下面介绍一下怎么样禁止搜索引擎收录网站内容。

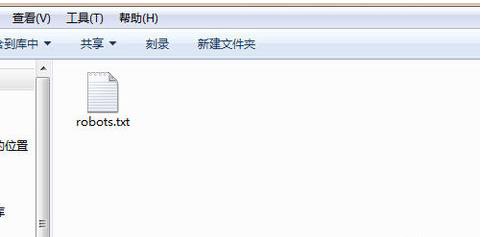

新建一个命名为“robots”的文本文件,robots文件是搜索引擎和网站之间的一个协议。

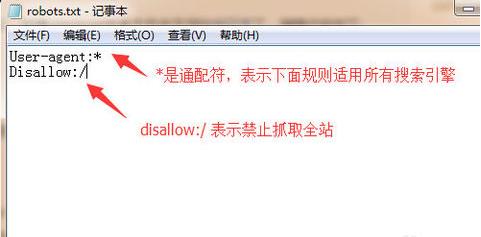

设置搜索引擎和网站之间的协议,User-agent:*表示和所有搜索引擎协议适用;Disallow:/表示禁止抓取收录全站。

如果只是禁止某一个搜索引擎抓取收录网站的某一个目录,比如要禁止百度抓取收录jinzhi目录,则如图设置。

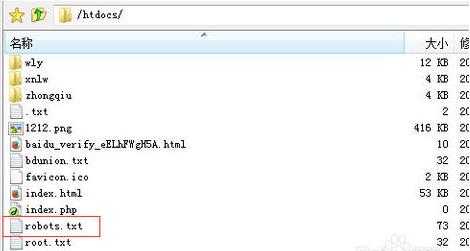

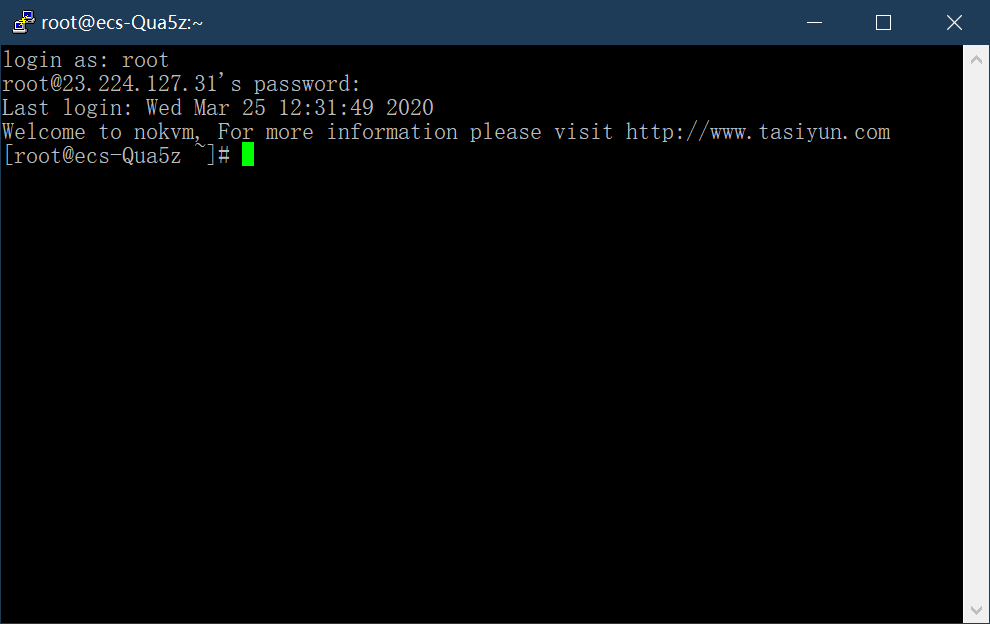

保存文件后,把文件上传到服务器根目录,即表示搜索引擎和网站之间的协议生效,可以禁止搜索引擎抓取收录网站内容。

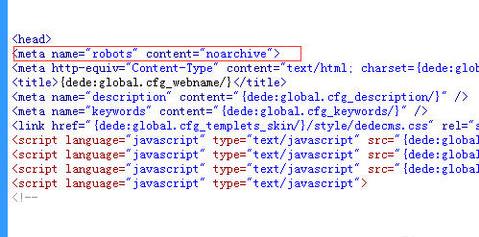

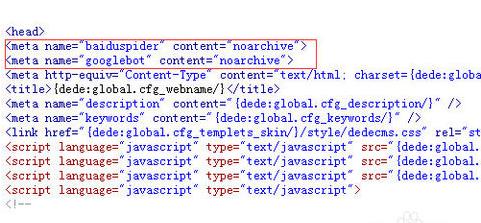

除了设置robots协议之外,还可以在网页代码里面设置。在网页<head></head>之间加入<meta name="robots" content="noarchive">代码。表示禁止所有搜索引擎抓取网站和显示快照。

如果要针对某一个搜索引擎禁止抓取,在网页<head></head>之间加入<meta name="baidspider" content="noarchive">代码,表示禁止百度抓取,<meta name="googlebot" content="noarchive">表示禁止谷歌抓取,其他的搜索引擎一样原理。

本文地址:https://www.wangzhijun.com.cn/post/43.html

温馨提示:文章内容系作者个人观点,不代表王志军博客对观点赞同或支持。

版权声明:本文为转载文章,来源于 网络 ,版权归原作者所有,欢迎分享本文,转载请保留出处!

温馨提示:文章内容系作者个人观点,不代表王志军博客对观点赞同或支持。

版权声明:本文为转载文章,来源于 网络 ,版权归原作者所有,欢迎分享本文,转载请保留出处!

发表评论